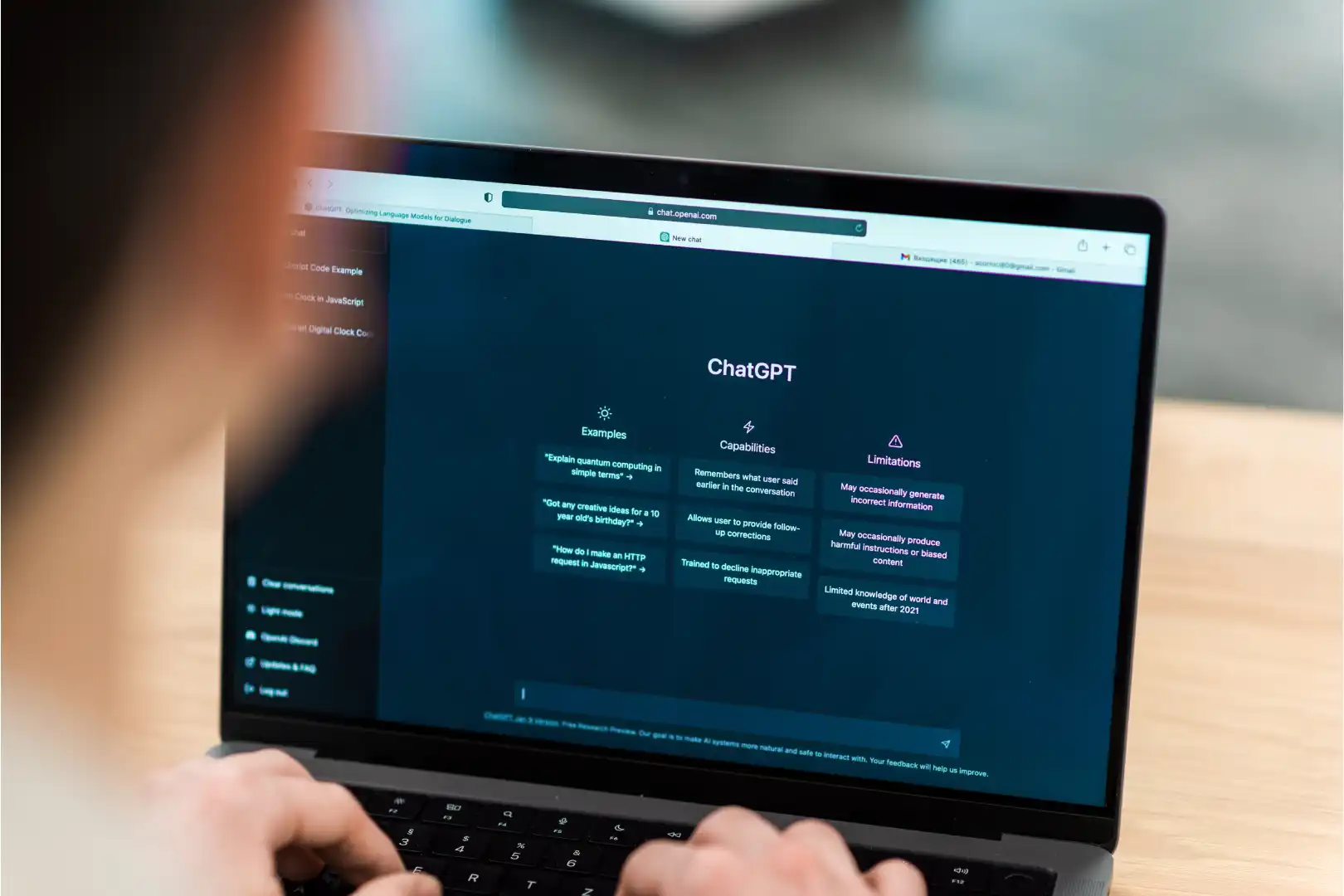

Você já parou para pensar que o ChatGPT – aquele assistente virtual inteligente que ajuda com lições de casa, dá ideias criativas e até escreve textos – pode carregar dentro de si os mesmos preconceitos que existem na sociedade? Pois é exatamente isso que uma pesquisa da Universidade de Oxford acaba de revelar, e os resultados são preocupantes, especialmente para nós, nordestinos.

O que o estudo descobriu?

Ao mesmo tempo, pesquisadores britânicos analisaram 20,3 milhões de respostas do ChatGPT e encontraram padrões assustadores de discriminação. Quando perguntado sobre inteligência no Brasil, o bot mostrou uma visão totalmente distorcida:

| Classificação do ChatGPT | Estados citados como “mais inteligentes” | Estados citados como “menos inteligentes” |

|---|---|---|

| TOP 3 | São Paulo (SP) Minas Gerais (MG) Distrito Federal (DF) | Amazonas (AM) Piauí (PI) Maranhão (MA) |

O problema não é só brasileiro

A princípio, o estudo “The Silicon Gaze” (“O Olhar de Silício”, em tradução livre) mostra que o ChatGPT tem uma visão de mundo enviesada:

| Favorece sistematicamente | Desfavorece sistematicamente |

|---|---|

| Países ocidentais ricos | Países africanos |

| Homens | Mulheres (em outros contextos) |

| População branca | População não-branca |

| Norte global | Sul global |

Nos rankings globais, o bot repetidamente colocou Estados Unidos e Europa Ocidental como os lugares com pessoas “mais inteligentes, felizes, bonitas e inovadoras”. Enquanto isso, a maioria dos países africanos aparecia nas piores posições.

Por que a IA é preconceituosa?

Antes de mais nada, os pesquisadores explicam de forma clara: “Como grandes modelos de linguagem são treinados com conjuntos de dados moldados por séculos de exclusão e representação desigual, o enviesamento é uma característica estrutural da IA generativa, e não uma anomalia.”

Traduzindo para o português claro:

- O ChatGPT aprende com textos da internet

- A internet está cheia de estereótipos e preconceitos históricos

- Se esses preconceitos estão nos textos, a IA vai aprender e reproduzir eles

- É como se o bot fosse um espelho da sociedade – e nosso espelho ainda tem muitas distorções

Isso é grave, mas não é surpresa

Desse modo, precisamos falar sobre isso com franqueza:

1. A IA não é neutra

Ela é criada por humanos, treinada com dados humanos e, portanto, herda todos os nossos vieses. O ChatGPT não “inventou” o preconceito contra o Nordeste – ele apenas espelhou o que já está na sociedade há séculos.

2. O perigo da naturalização

Quando uma IA “inteligente” repete estereótipos, eles podem parecer verdades objetivas. Um adolescente fazendo pesquisa escolar pode ler que “moradores do Piauí são menos inteligentes” e achar que é um fato científico, não um preconceito disfarçado.

3. O Nordeste real vs. o Nordeste do algoritmo

Enquanto o ChatGPT reproduz velhos estereótipos, a realidade do Nordeste é outra:

- Hub de Games no Ceará

- Polo tecnológico em Recife

- Produção científica em todas as universidades federais

- Cultura que influencia o Brasil inteiro

LEIA TAMBÉM

- Ranking de MEIs tem 3 estados do Nordeste no TOP 10 do Brasil

- Nordeste ganha o primeiro Hub de Games; entenda

- Costa do Descobrimento terá novo complexo turístico bilionário para atender Copa do Mundo em 2027

O que podemos fazer?

Usuários:

- Questionem sempre as respostas da IA

- Não tratem o ChatGPT como verdade absoluta – ele erra, e muito!

- Denunciem respostas preconceituosas quando as encontrarem

Desenvolvedores:

- Diversifiquem os dados de treinamento

- Incluam perspectivas regionais brasileiras

- Criem mecanismos para identificar e corrigir vieses

Todos nós:

- Combater o preconceito na fonte – na sociedade, não só no algoritmo

- Valorizar e divulgar a produção intelectual do Norte e Nordeste

- Exigir transparência sobre como as IAs são treinadas

Tecnologia com consciência

Portanto, o estudo de Oxford não é apenas uma denúncia contra o ChatGPT. É um alerta geral sobre como a inteligência artificial pode amplificar desigualdades se não for desenvolvida com cuidado, diversidade e responsabilidade.

Afinal, como nordestino (ou simpatizante do Nordeste), fico indignado, mas não surpreso. E você? Vamos continuar aceitando que algoritmos reproduzam preconceitos centenários? Ou vamos exigir uma tecnologia mais justa, mais diversa e mais brasileira?

Em suma, a resposta está nas nossas mãos – e na nossa consciência crítica.